一、高仿真度三维重建技术

拍摄几张照片,就能快速生成3D模型。在工作人员的指导下,参观者站在摄像头下绕转360度,耗时1分钟,电脑上便出现了3D虚拟模型。

对于室内场景,手持Kinect体感设备围绕物体扫描或者利用数码照相机拍照即可生成3D虚拟物体和场景;对于室外场景,通过普通相机拍照、航拍、遥感等获得的2D照片生成高仿真度3D物体和场景。

二、GPU集群实时渲染技术

现有电影中的渲染技术是离线方式,实时渲染则是对虚拟环境和对象进行实时在线渲染,获得可实时交互的视频,进而实现交互式电影。

三、肢体运动捕捉技术

电影中虚拟角色的动作生成往往需要通过昂贵的专业运动捕捉系统实现,本项技术只需多个Kinect配合即可生成稳定可靠的动作帧序列,成本低廉。

四、表情克隆技术

利用简单的摄像头实时拍摄人脸,可将人脸表情实时赋予虚拟角色。

五、混合现实拍摄技术

在实景拍摄中实时融入虚拟角色,两者高自然度融合,减少拍摄返工。在离线状态时,借助点匹配和面匹配,将3D虚拟对象与实拍视频中的真实对象进行匹配和高度融合,这在具有虚实融合元素等科幻、魔幻类电影的后期制作中具有重大应用价值。

六、混合模态交互技术

通过语音、手势和表情等实现人与虚拟角色的互动和交流。

七、个性化语音合成和变声技术

将文本转化为语音,以及一个人的语音语调等个性化发声方式转化为另一人或其他具有一定特点的发声方式。

八、无线便携式运动姿态传感装置

可通过简单穿戴和设计,实现室内定位以及关节的运动和姿态跟踪。

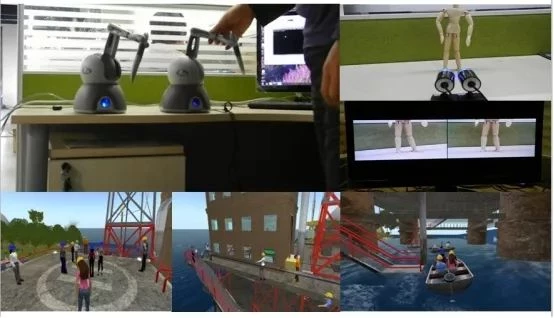

九、高沉浸感异地遥现技术

将本地3D立体场景。通过网络在异地呈现出来,使异地用户可视、可听,可触本地信息。实现方式有两种:一种方式是3D立体视频会议系统捕获立体视频,一种是分布式虚拟环境。

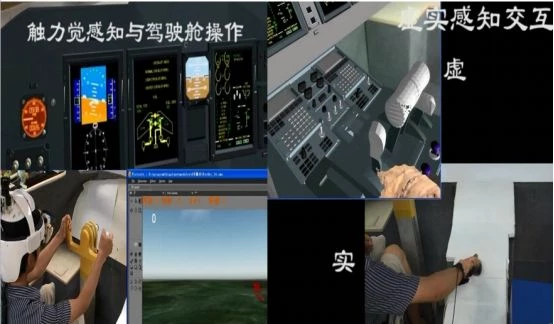

十、七自由度触力觉交互技术

利用该设备可将虚拟环境中物体间的作用力、力矩实时反馈出来,用户也可利用该设备进行力、力矩的输入来操控虚拟对象,进而增强用户沉浸感等。这些都是研究院重点研发的内容。